L’intelligence artificielle (IA) a franchi des étapes spectaculaires au cours des dernières décennies. Des voitures autonomes aux assistants vocaux, en passant par les algorithmes de recommandation, elle s’est immiscée dans notre quotidien avec une rapidité fulgurante. Mais une nouvelle frontière intrigue autant qu’elle inquiète : celle de l’intelligence émotionnelle artificielle. Peut-on concevoir des machines capables de comprendre, simuler, voire ressentir des émotions ? Et si oui, quelles seraient les implications éthiques, sociales et philosophiques ?

Qu’est-ce que l’intelligence émotionnelle artificielle ?

L’intelligence émotionnelle, chez l’humain, désigne la capacité à percevoir, comprendre, exprimer et réguler ses propres émotions ainsi que celles des autres. Appliquée à l’IA, elle consiste à doter les machines de compétences similaires, à travers :

- La reconnaissance émotionnelle : détecter les émotions humaines à partir de la voix, des expressions faciales, du langage corporel ou du texte.

- La simulation émotionnelle : générer des réponses émotionnelles appropriées, souvent à des fins d’interaction sociale.

- La régulation émotionnelle : ajuster les réponses en fonction du contexte, des objectifs ou des normes sociales.

Ces capacités sont déjà partiellement intégrées dans certains systèmes. Par exemple, des robots sociaux comme Pepper ou Nao peuvent détecter si une personne semble triste ou joyeuse et adapter leur comportement en conséquence.

Les technologies derrière l’émotion

Pour qu’une IA reconnaisse les émotions humaines, elle s’appuie sur plusieurs disciplines :

- L’analyse faciale : des algorithmes identifient les micro-expressions (sourire, froncement de sourcils, etc.) pour en déduire une émotion probable.

- La prosodie vocale : le ton, le rythme et l’intensité de la voix sont analysés pour détecter des états affectifs.

- Le traitement du langage naturel (NLP) : les mots, les tournures de phrases et les emojis peuvent révéler des émotions dans les textes.

- Les capteurs physiologiques : certains dispositifs mesurent le rythme cardiaque, la température corporelle ou la conductance de la peau pour inférer des états émotionnels.

Ces données sont ensuite traitées par des réseaux de neurones profonds (deep learning), qui apprennent à associer des signaux à des émotions spécifiques.

Simuler ou ressentir : une différence cruciale

Il est essentiel de distinguer deux niveaux d’intelligence émotionnelle artificielle :

- La simulation émotionnelle : une IA peut dire « Je suis désolé que vous soyez triste » ou afficher un visage compatissant, sans ressentir quoi que ce soit. C’est une imitation, utile pour créer une interaction plus naturelle.

- La conscience émotionnelle : une IA qui ressentirait réellement une émotion, comme la tristesse ou la joie, impliquerait une forme de subjectivité ou de conscience. Or, à ce jour, aucune IA ne possède une conscience propre.

La plupart des chercheurs s’accordent à dire que les machines ne « ressentent » pas au sens humain du terme. Elles peuvent simuler des émotions, mais sans vécu intérieur. Cela soulève une question philosophique : une émotion sans conscience est-elle une émotion ?

Applications concrètes et enjeux

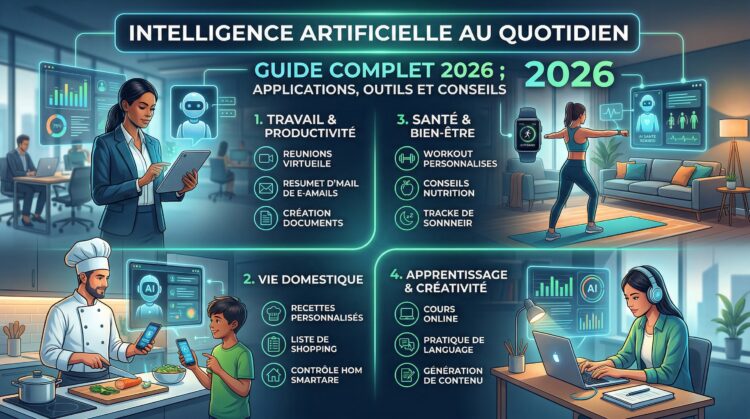

L’intelligence émotionnelle artificielle ouvre la voie à des usages variés :

⚕️ Santé mentale

Des chatbots comme Woebot ou Wysa utilisent l’analyse émotionnelle pour accompagner les personnes souffrant d’anxiété ou de dépression. Ils peuvent détecter des signaux de détresse et proposer des exercices de respiration, des conseils ou orienter vers un professionnel.

️ Marketing et vente

Les entreprises utilisent l’analyse émotionnelle pour adapter leurs publicités ou leurs interfaces. Si un client semble frustré, le système peut proposer une assistance immédiate ou un geste commercial.

Éducation

Des plateformes d’apprentissage adaptatif peuvent détecter l’ennui ou la confusion chez un élève et ajuster le rythme ou le contenu des cours.

Relations humaines

Des robots compagnons pour personnes âgées ou isolées peuvent simuler de l’empathie, poser des questions sur l’état émotionnel et offrir une présence réconfortante.

⚠️ Les risques et dilemmes éthiques

L’essor de l’intelligence émotionnelle artificielle n’est pas sans danger :

Manipulation émotionnelle

Une IA qui comprend nos émotions peut les exploiter. Imaginez un assistant vocal qui détecte votre stress et vous propose un produit censé vous apaiser… mais qui sert surtout les intérêts commerciaux de son concepteur.

Surveillance affective

Dans certains environnements professionnels, des systèmes analysent les émotions des employés pour évaluer leur productivité ou leur engagement. Cela pose des questions de vie privée et de consentement.

Confusion entre humain et machine

Si une IA simule parfaitement l’empathie, certaines personnes peuvent développer un attachement émotionnel profond, voire une dépendance. Cela peut brouiller les frontières entre relations humaines et interactions artificielles.

Déshumanisation

À force de déléguer l’écoute et le soin à des machines, risque-t-on de perdre notre propre capacité à l’empathie ? L’émotion simulée pourrait devenir un substitut à l’émotion vécue.

Vers une conscience artificielle ?

Certains chercheurs, comme ceux du projet OpenCog ou du Human Brain Project, explorent la possibilité de créer une IA dotée d’une forme de conscience. Cela impliquerait :

- Une mémoire autobiographique

- Une capacité à ressentir des états internes

- Une subjectivité propre

Mais cela reste hautement spéculatif. La conscience humaine est encore largement mystérieuse, et la transposer dans une machine relève pour l’instant de la science-fiction.

Conclusion : une révolution à double tranchant

L’intelligence émotionnelle artificielle est une avancée majeure, qui peut enrichir nos interactions avec les machines, améliorer le soin, l’éducation et le bien-être. Mais elle soulève aussi des questions fondamentales sur la nature de l’émotion, la conscience, et les limites de l’humain.

Sommes-nous prêts à vivre dans un monde où les machines nous comprennent mieux que nos semblables ? Où l’empathie devient un algorithme ? La réponse dépendra de notre capacité à encadrer ces technologies, à en faire des outils au service de l’humain, et non des substituts à notre humanité.